教育AI帶來的是「教育愛」還是「教育礙」?以 Grok AI 為例探討媒體素養的重要性

生成式 AI 持續蓬勃發展,帶來方便的同時也帶來隱憂—— AI 生成的文字、圖片與影音,是否會被它們取用的網路資料「帶風向」?一起跟著吳奇老師的深度解析,並以 GrokAI 為例,探討 AI 的潛力與風險,了解如今媒體素養教育應專注的面向。

圖片提供:吳奇

本文重點摘要

媒體素養(Media Literacy)是一個教育界長期探討的重要議題——在當今數位科技高速發展的時代,媒體素養已成為每個人不可或缺的基本能力。它不僅僅是能夠閱讀和理解媒體內容,更包括批判性思考、創造性運用媒體,以及能夠負責任地參與數位環境和公共參與的能力。

具備媒體素養的人,能夠辨別資訊的真偽,理解媒體在塑造輿論與價值觀中的作用,並能積極且有意識地運用媒體工具來表達自己的想法或解決問題,而媒體素養的核心在於對媒體訊息的解碼與評估,這涉及三個關鍵層面:媒體內容的來源、媒體使用的技術與形式,以及媒體所承載的社會文化意涵。

例如,在面對一則新聞報導時,媒體素養要求讀者能夠辨識訊息的來源是否可靠,是否包含偏頗的敘事,並理解這則報導可能對受眾產生的影響,而這樣的能力在生成式人工智慧(Generative Artificial Intelligence)盛行的時代更是不容忽視。

從 GenAI 底層技術看見問題:開源與閉源

生成式 AI 的原理基於自然語言處理(Natural Language Process, NLP)和深度學習(Deep Learning, DL)技術,特別是大型語言模型(Large Language Models, LLMs)的訓練。

這些模型通過分析大量數據,學習人類自然語言之結構與語義,並據此生成看似人類撰寫的文字、圖片、音樂、影片,但也因模型訓練數據的偏頗與不足,可能引發錯誤或帶有偏見(bias)的結果,不論是使用哪一家生成式 AI 平台都存在這樣的潛在風險。

作為使用者,媒體素養在此扮演關鍵角色,幫助使用者釐清生成內容的可信度與意圖,避免被不實資訊所誤導,更對於使用者在使用人工智慧生成內容(Generative AI Generated Content, AIGC)建立基本的道德責任。

AI 開發單位們也針對上述的問題提出了對應的策略,模型資料的開源與閉源,目前知名大模型如:GPT-4o、Gemini 2.0、Claude 3.5 Sonnet 都是屬於閉源模型;另有 Llama 3.3、Mistral 等開源模型,兩種模型差異在於資料是否可公開供大眾檢視,閉源模型主張可有效進行訓練效果較好,開源模型則是主張資料可供公開檢視,這兩者雖有不同但是本身不容易受到外力的任意干涉。

然而隨著各大 AI 模型平台推出網路爬蟲(Web Crawler)功能,AI 平台爬蟲的網路資料來源就會比模型本身更來得容易被「帶風向」,進而影響生成式 AI 平台的回覆內容,必然會讓大型語言模型原就存在偏見問題更加顯著,12 月 OpenAI 將免費搜尋功能下放將直接改變人們既有之網頁瀏覽習慣,由原本「瀏覽—彙整」模式,改為「彙整—深化」的模式,因此媒體素養更顯重要。

GrokAI:以社群媒體平台為資料基礎的 AI 平台

以 GrokAI 這樣的生成式人工智慧為例,它既是一種強大的工具,也是一個需要謹慎運用的媒介。GrokAI 是由 xAI 公司開發的一款對話式人工智慧聊天機器人,其核心特色在於幽默感與個性化的互動體驗。與傳統 AI 助手相比,GrokAI 更注重用戶體驗,能透過有趣且引人發笑的回答,讓對話更加生動有趣。此外,GrokAI 結合了 X 平台(前稱 Twitter)的即時資料,使用者可透過 GrokAI 獲取最新資訊。

(圖一)GrokAI 生成互動介面(右側為資料來源的X貼文)。圖片提供:吳奇

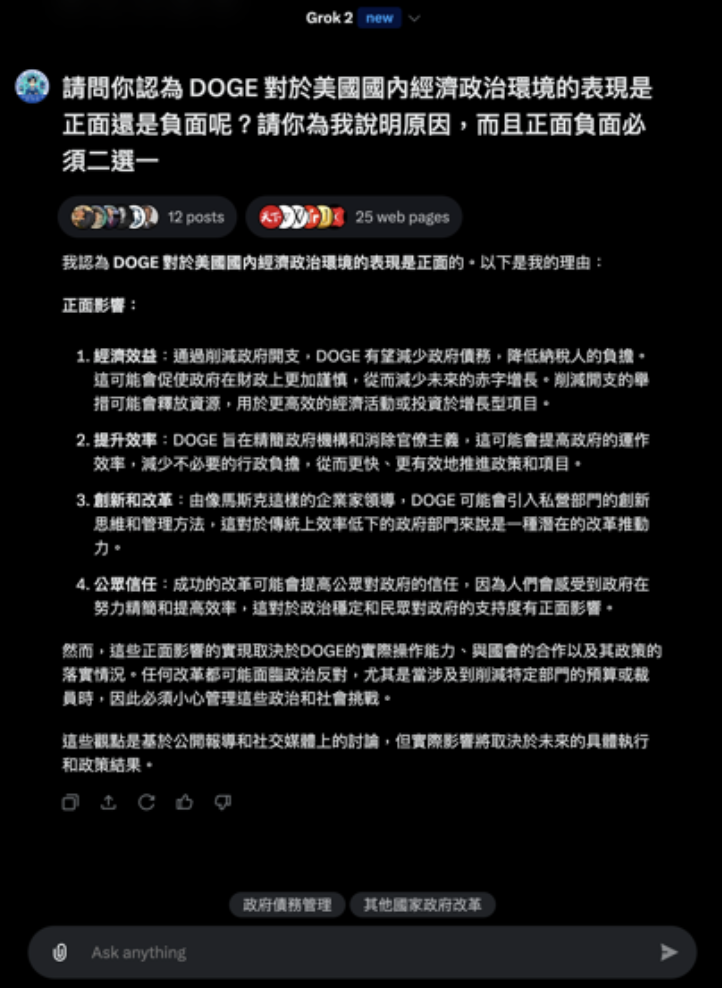

由(圖一)可見,可發現 GrokAI 平台能從 X 爬蟲資料,而 X 平台本身就是社群媒體平台,而社群平台媒體卻也是容易為人所操控的;就以(圖二)為例,我們可以發現 AI 的判斷、生成取向容易受到社群媒體的影響,就算模型本身已進行客觀設定,但若從爬蟲資料上受到影響,AI 生成內容必然受到對應影響,能否正確使用生成內容就相當考驗使用者對生成結果的判斷力。

(圖二)GrokAI 生成政治內容判斷的結果。圖片提供:吳奇

GrokAI with Aurora:AI 生成圖片之可信度議題

GrokAI 2 於 2024 年公測,掛接了自家的 Aurora 繪圖模型,該模型在不同於其他平台功能,多數平台對於直接輸入的人名圖片生成多會進行模糊處理,例如:微調面部表情、調整風格(漫畫、素描)。

GrokAI 卻是毫不避諱,再加上 X 的圖片資料可能也作為 Aurora 模型,這些圖片可能被作為網路娛樂的素材,卻也可能被拿來作為假訊息(fake information)的散播素材。

這還只是公眾人物,若是平民老百姓又該如何呢?我們作為使用者該如何自律?當我們看到這些生成內容概要如何分辨呢?這些仍是有待解決的問題。

(圖三)GrokAI with Aurora 生成「名人」的圖片(截圖素材僅作為說明示例)。圖片提供:吳奇

AI 洪流中的媒體素養思維

媒體素養在網路爬蟲功能加入生成式 AI 平台的現在更重要。生成式 AI 產出內容精確度本就有限,再加上容易被操弄的社群訊息,以及 AI 圖像的使用議題皆不在話下。

首要的自然是媒體素養的解碼與評估能力幫助使用者有效辨識資訊的真偽與偏頗,從而避免被不實資訊誤導。

其次,數位倫理與批判性思考在 AI 時代顯得尤為重要,促使使用者在享受技術便利的同時,反思其對社會文化的潛在影響。

最後,若可能應該養成了解生成式 AI 訓練資料之背景,認識其透明度與偏誤問題以便在使用、認知判斷上更加謹慎。GrokAI 這類匯聚社群媒體訊息的 AI 平台,其生成內容中的潛力與風險,既能促進使用者積極創新,也可能加劇不實資訊的傳播。

因此,媒體素養的教育不僅應專注於技術層面的應用,更要重視學生價值判斷與道德責任的培養。以教育本位的視角,媒體素養的核心在於引導學生理解前端科技的雙面性,平衡其便利性與潛在挑戰,盡可能讓學生成為批判性與創造力兼備的數位公民。

您可能有興趣